Einleitung

Die rasante Entwicklung von KI hat in den letzten Jahren vielfältige Anwendungsbereiche erschlossen, darunter auch den Bereich des wissenschaftlichen Schreibens. Insbesondere sogenannte Large Language Models (LLM) wie zum Beispiel ChatGPT gewinnen zunehmend an Bedeutung als digitale Schreibassistenz. Diese Werkzeuge bieten eine Vielzahl an Funktionalitäten – von der Ideen- und Bildgenerierung über die Strukturierung von Texten bis hin zur sprachlichen Optimierung [1,2].

Die Nutzung solcher KI-Systeme im akademischen Kontext wirft jedoch grundlegende Fragen auf:

Inwiefern können Chatbots die wissenschaftliche Arbeit unterstützen, ohne den Anspruch auf Eigenleistung und wissenschaftliche Integrität zu untergraben?

Wo liegen die Chancen – etwa in der Effizienzsteigerung oder der Erweiterung kreativer Prozesse – und wo lauern potenzielle Risiken, wie etwa eine unkritische Übernahme generierter Inhalte, Verlernen von eigenen Ideen und der Schreibvielfalt oder ethische Grauzonen hinsichtlich Urheberschaft und Plagiat [1,3,4].

Diese Arbeit setzt sich zum Ziel, die Potenziale und Herausforderungen der Nutzung von KI-Chatbots im wissenschaftlichen Schreibprozess kritisch zu analysieren. Dabei wird sowohl auf die technischen Möglichkeiten als auch auf didaktische, ethische und rechtliche Implikationen eingegangen. Ziel ist es, einen differenzierten Beitrag zur aktuellen Debatte über den verantwortungsvollen Einsatz von KI in der Wissenschaft zu leisten.

Material und Methoden

Um die Potenziale und Herausforderungen der Nutzung von KI-Chatbots im wissenschaftlichen Schreiben empirisch zu untersuchen, wurde eine quantitative Online-Umfrage unter Studierenden und wissenschaftlich Mitarbeitenden an perfusiologieassoziierten deutschsprachigen Hochschulen sowie an verschiedenen Kliniken durchgeführt. Zu den befragten Hochschulen gehörten die Akademie für Kardiotechnik des Deutschen Herzzentrums Berlin, Hochschule Furtwangen, FH Aachen, FH Münster und die medizinische Fakultät Heidelberg. Des Weiteren wurden die Mitglieder der Deutschen Gesellschaft für Perfusiologie und Technische Medizin (DGPTM) mittels E-Mail eingeladen, sich an der Umfrage zu beteiligen. Ziel der Befragung war es, sowohl die Nutzungshäufigkeit und Einsatzbereiche von KI-Chatbots als auch die Einstellungen und Bedenken gegenüber dem Einsatz der KI im wissenschaftlichen Kontext zu erfassen.

Die Studie wurde als deskriptive Querschnittserhebung konzipiert. Die Erhebung erfolgte mittels eines standardisierten Online-Fragebogens, der über verschiedene hochschulinterne Verteiler und soziale Netzwerke verbreitet wurde. Die Teilnahme war anonym und freiwillig. Die Umfrage wurde im Zeitraum vom 01.06.2025 bis 30.06.2025 durchgeführt.

Der Fragebogen umfasste insgesamt 20 geschlossene sowie drei offene Fragen und gliederte sich in folgende Themenbereiche:

- Demografische Daten (z. B. Studiengang, Fachsemester, wissenschaftliche Tätigkeit)

- Nutzung von KI-Chatbots (Häufigkeit, Anwendungsbereiche wie Literaturrecherche, Textüberarbeitung, Ideengenerierung)

- Subjektive Bewertung (z. B. wahrgenommene Nützlichkeit, Einfluss auf den Schreibprozess, Vertrauen in die generierten Inhalte)

- Ethische und rechtliche Einschätzungen (z. B. Urheberrecht, Plagiatsrisiken, Verantwortungsbewusstsein)

- Offene Fragen zur individuellen Einschätzung von Chancen und Risiken

Die Fragen wurden als Likert-Skala (1 = stimme nicht zu bis 5 = stimme voll zu) oder als Multiple Choice formuliert. Der Fragebogen stellte sich wie folgt dar:

1. Allgemeine Angaben

- In welchem Fachbereich sind Sie tätig? Antwortmöglichkeiten:

Geisteswissenschaften, Sozialwissenschaften, Naturwissenschaften, Ingenieurwissenschaften, Wirtschaftswissenschaften, Medizin/Gesundheitswissenschaften und Sonstiges (Freitext).

- Wie lange arbeiten Sie bereits in der Wissenschaft? Antwortmöglichkeiten:

< 1 Jahr, 1–3 Jahre, 4–6 Jahre, > 6 Jahre

- Welche Position trifft am besten auf Sie zu? Antwortmöglichkeiten:

Postdoc, Doktorand:in, Professor:in, Student:in, ärztliches Personal, nichtärztliches Personal

2. Nutzung von KI in wissenschaftlichen Arbeiten

- Haben Sie bereits KI genutzt? Antwortmöglichkeiten:

Ja oder Nein (–> Weiter zu Abschnitt V)

- Wie häufig verwenden Sie KI in Ihrem wissenschaftlichen Alltag?

Antwortmöglichkeiten:

täglich, wöchentlich, monatlich, seltener, nie

- In welchen Bereichen setzen Sie KI ein? (Mehrfachauswahl möglich) Antwortmöglichkeiten:

Ideenfindung/Themenfindung, Gliederung/Strukturierung von Texten, Formulierungshilfe/Sprachoptimierung, Zusammenfassungen/Literaturübersichten, Übersetzungen, Programmierhilfe (z. B. bei Datenanalysen), Sonstiges (Freitext)

- Wahrnehmung und Bewertung

- Inwiefern stimmen Sie den folgenden Aussagen zu? (1 = stimme gar nicht zu, 5 = stimme voll zu)

KI unterstützt mich effektiv beim wissenschaftlichen Schreiben.

Aussage 1 2 3 4 5

Die Nutzung von KI spart mir Zeit bei bestimmten Aufgaben.

Aussage 1 2 3 4 5

KI generiert überwiegend inhaltlich brauchbare Vorschläge.

Aussage 1 2 3 4 5

Ich überprüfe die Ausgaben von KI stets kritisch.

Aussage 1 2 3 4 5

KI beeinflusst meine eigene Schreibweise.

Aussage 1 2 3 4 5

KI unterstützt mich dabei, unliebsame Aufgaben effizienter zu erledigen, sodass ich mehr Zeit für spannendere Themen habe.

Aussage 1 2 3 4 5

- Ethische und rechtliche Einschätzungen

- Wie schätzen Sie die folgenden Aussagen ein? (1 = stimme gar nicht zu, 5 = stimme voll zu)

Aussage 1 2 3 4 5

Der Einsatz von KI stellt ein Risiko für die wissenschaftliche Integrität dar.

Aussage 1 2 3 4 5

Die Grenzen zwischen Hilfsmittel und Plagiat sind beim Einsatz von KI schwer erkennbar.

Aussage 1 2 3 4 5

Für wissenschaftliches Arbeiten sollte es klare Richtlinien zur KI-Nutzung geben.

Aussage 1 2 3 4 5

Ich empfinde ethische Bedenken bei der Nutzung von KI.

Aussage 1 2 3 4 5

Ich mache mir Sorgen, dass KI meinen Arbeitsplatz ersetzen könnte.

Aussage 1 2 3 4 5

Die Bildungseinrichtungen sind gut auf künstliche Intelligenz sowie die damit verbundenen Veränderungen vorbereitet oder haben sich bereits entsprechend angepasst.

Aussage 1 2 3 4 5

Das allgemeine Niveau des Lese- und Schreibverständnisses von Menschen wird sich bei dauerhafter Nutzung von Chatbots verschlechtern.

Aussage 1 2 3 4 5

- Offene Fragen

- Welche Chancen sehen Sie in der Nutzung von KI für die wissenschaftliche Praxis?

- Welche Risiken oder Herausforderungen sehen Sie im Umgang mit KI?

- Welche Regelungen oder Leitlinien würden Sie sich für den Einsatz von KI-Tools im wissenschaftlichen Kontext wünschen?

Statistik

Die Auswertung der quantitativen Daten erfolgte mittels der integrierten Funktion von Google Forms, wobei für die Fragen mit Bewertungsskala der Mittelwert berechnet wurde. Für die qualitative Analyse der offenen Fragen wurde der KI-Chatbot Gemini (Google) zur thematischen Zusammenfassung heran-gezogen [5].

Ergebnisse

An der Umfrage nahmen insgesamt 117 Personen teil. Mit 106 Personen (90,6 %) stammte der überwiegende Teil aus der Medizin und den Gesundheitswissenschaften. Weitere Fachbereiche waren die Ingenieurwissenschaften (4 Personen, 3,4 %), Sozialwissenschaften (3 Personen, 2,6 %), Naturwissenschaften (2 Personen, 1,7 %) sowie die Geisteswissenschaften und das Scientific Marketing mit jeweils einer Person (0,9 %).

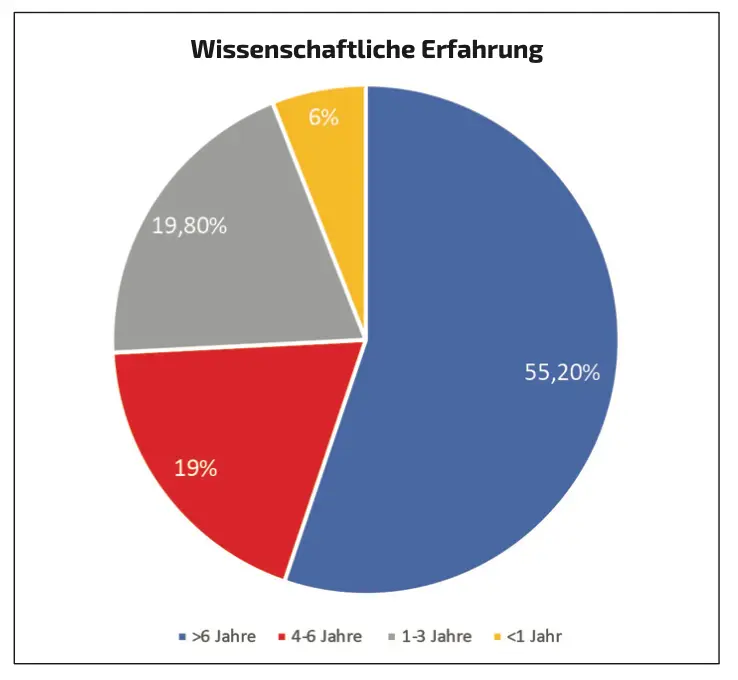

Hinsichtlich der wissenschaftlichen Erfahrung gaben die meisten Befragten (64 Personen, 55,2 %) an, seit über sechs Jahren wissenschaftlich tätig zu sein. 22 Personen (19 %) hatten 4–6 Jahre Erfahrung, 23 (19,8 %) 1–3 Jahre und 7 (6 %) weniger als ein Jahr (Abb. 1). Das Teilnahmefeld setzte sich aus jeweils 40 ärztlichen und nichtärztlichen Mitarbeitenden (je 34,5 %), 17 Studierenden (14,7 %), 8 Postdocs (6,9 %), 6 Professor:innen (5,2 %) und 5 Doktorand:innen (4,3 %) zusammen.

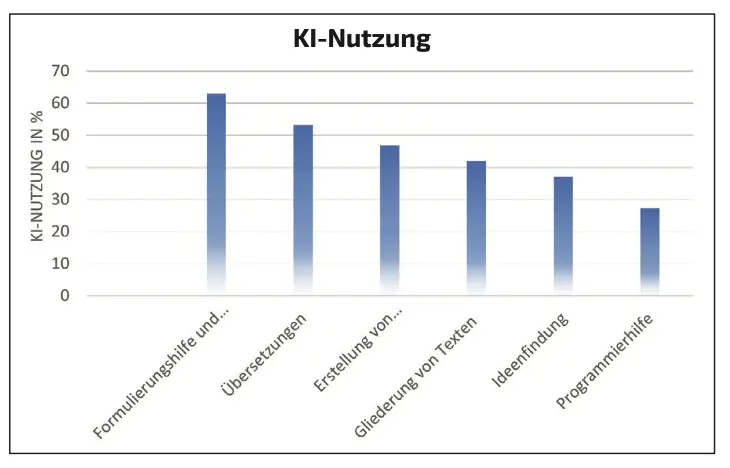

Bei der KI-Nutzung und deren Anwendungsbereichen gaben von 81 der 117 Teilnehmenden (69,2 %) an, bereits Erfahrungen mit KI-Tools gesammelt zu haben. Unter den KI-Nutzenden waren die häufigsten Anwendungen Formulierungshilfe und Sprachoptimierung (63 %), gefolgt von Übersetzungen (53,1 %), der Erstellung von Zusammenfassungen/Literaturübersichten (46,9 %), der Gliederung von Texten (42 %), der Ideenfindung (37 %) sowie der Programmierhilfe (27,2 %) (Abb. 2).

Die Bewertung der KI-Nutzung wurde auf einer Skala von 1 bis 5 bezüglich der Nützlichkeit von KI bewertet. Während die Aussage „KI unterstützt mich effektiv beim wissenschaftlichen Schreiben“ eine mittlere Zustimmung erhielt (M = 3,53), wurde der zeitsparende Aspekt deutlich positiver gesehen. Die Aussage „Die Nutzung von KI spart mir Zeit bei bestimmten Aufgaben“ erreichte eine hohe Zustimmung (M = 4,14), wobei 46,9 % der Nutzenden die volle Punktzahl vergaben.

Die Qualität der generierten Inhalte wurde kritischer beurteilt („KI generiert überwiegend inhaltlich brauchbare Vorschläge“, (M = 3,01)). Passend dazu gaben die Befragten mit einer Mehrheit an, die Ausgaben der KI stets kritisch zu überprüfen (M = 4,62).

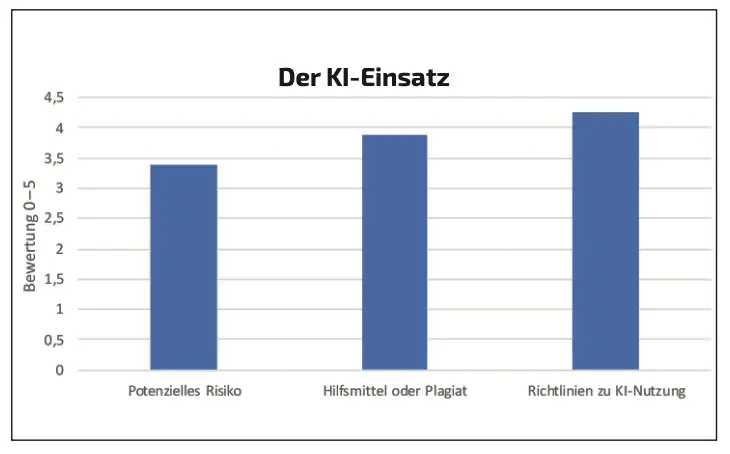

Der KI-Einsatz wurde als potenzielles Risiko für die wissenschaftliche Integrität wahrgenommen (M = 3,38), und viele Teilnehmende stimmten zu, dass die Grenzen zwischen Hilfsmittel und Plagiat schwer erkennbar sind (M = 3,87). Folgerichtig war die Forderung „Für wissenschaftliches Arbeiten sollte es klare Richtlinien zur KI-Nutzung geben“ eine der Aussagen mit der höchsten Zustimmung im gesamten Fragebogen (M = 4,26) (Abb. 3).

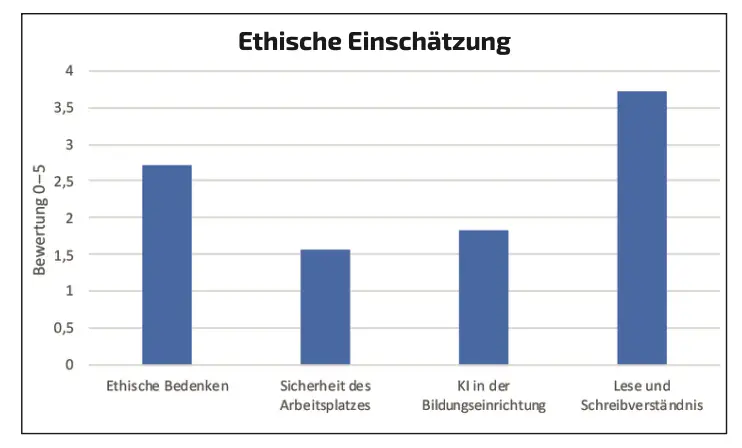

Ethische Bedenken wurden nur verhalten geäußert (M = 2,71). Die Angst, der eigene Arbeitsplatz könnte durch KI ersetzt werden, bekam die niedrigste Durchschnittsbewertung der Umfrage (M = 1,56). Sehr kritisch beurteilten die Teilnehmenden den Vorbereitungsstand der Bildungseinrichtungen, den sie als mangelhaft einschätzten (M= 1,82). Gleichzeitig bestand die Sorge, dass sich das allgemeine Lese- und Schreibverständnis durch die dauerhafte Nutzung von Chatbots verschlechtern könnte (M = 3,71) (Abb. 4).

Diese quantitativen Ergebnisse spiegeln sich auch in den Antworten auf die offene Frage wider, zu der sich 47 (40,2 %) Personen äußerten. Die zentrale und häufigste genannte Forderung war eine verpflichtende und detaillierte Kennzeichnung der KI-Nutzung in der Wissenschaft. An zweiter Stelle stand der Wunsch nach klaren, einheitlichen Richtlinien durch Hochschulen oder Fachgesellschaften. Zudem wurde wiederholt angeregt, den Einsatz von KI auf unterstützende Tätigkeiten zu begrenzen, und Bedenken hinsichtlich des Datenschutzes und der Einhaltung der Datenschutz-Grundverordnung wurden explizit formuliert.

Diskussion

Die vorliegende Umfrage beleuchtet die Erfahrungen, Bewertungen und Erwartungen von Wissenschaftler:innen hinsichtlich des Einsatzes von KI in ihrer Arbeit. Die Ergebnisse zeigen ein differenziertes Bild, das die Potenziale von KI hervorhebt, aber auch kritische Aspekte und den Bedarf an klaren Rahmenbedingungen aufzeigt.

Die Zusammensetzung der Stichprobe, die überwiegend aus den Medizin- und Gesundheitswissenschaften stammt, spiegelt möglicherweise eine spezifische Perspektive wider, die durch die Anforderungen und ethischen Standards dieser Disziplinen geprägt ist. Die wissenschaftliche Erfahrung der Befragten (55,2 % mit über sechs Jahren Erfahrung) deutet darauf hin, dass es sich um eine Gruppe handelt, die bereits weit in wissenschaftliche Prozesse eingebunden ist und daher fundierte Einschätzungen zur KI-Nutzung geben kann.

Akzeptanz und Anwendungsbereiche von KI

Eine deutliche Mehrheit der Teilnehmenden hat bereits Erfahrungen mit KI-Tools gesammelt, was die rasche Integration dieser Technologien in den wissenschaftlichen Alltag unterstreicht. Die beliebtesten Anwendungsbereiche – Formulierungshilfe, Sprachoptimierung, Übersetzungen und Zusammenfassungen – zeigen, dass KI vorrangig als unterstützendes Werkzeug für textbasierte Aufgaben wahrgenommen wird. Dies stimmt mit der generellen Annahme überein, dass KI repetitive oder zeitaufwändige Aufgaben effizienter gestalten kann, um Forschenden mehr Kapazitäten für komplexere analytische oder kreative Prozesse zu schaffen [6–8].

Bewertung von Nutzen, Qualität und Zeitersparnis

Die Nützlichkeit von KI im wissenschaftlichen Schreiben wird ambivalent bewertet, während der zeitsparende Aspekt mit einer hohen Zustimmung deutlich positiver gesehen wird. Dies legt nahe, dass KI zwar als Effizienzsteigerung wahrgenommen wird, die Qualität der generierten Inhalte jedoch weiterhin kritisch betrachtet wird. Die Mehrheit der Befragten überprüft die Ausgaben der KI stets kritisch [9]. Dies ist eine entscheidende Aussage, die die Notwendigkeit menschlicher Kontrolle im Umgang mit KI-generierten Inhalten betont und vor unreflektierter Übernahme warnt [10]. Die kritische Beurteilung der inhaltlichen Brauchbarkeit bestätigt die Notwendigkeit dieser Überprüfung [11].

Ethische Bedenken und die Notwendigkeit von Richtlinien

Die Wahrnehmung von KI als potenzielles Risiko für die wissenschaftliche Integrität und die Schwierigkeit, die Grenzen zwischen Hilfsmittel und Plagiat zu erkennen, sind zentrale Bedenken. Dies unterstreicht die dringende Notwendigkeit klarer Richtlinien zur KI-Nutzung im wissenschaftlichen Arbeiten. Diese Forderung wurde auch in den offenen Antworten am häufigsten genannt, zusammen mit dem Wunsch nach verpflichtender und detaillierter Kennzeichnung der KI-Nutzung und einheitlichen Richtlinien von Hochschulen oder Fachgesellschaften. Ähnliche Forderungen werden auch in der aktuellen Fachliteratur diskutiert, um Missbrauch vorzubeugen und Transparenz zu gewährleisten [12–14]. Aktuell existieren auf europäischer Ebene bereits Gesetzesentwürfe, die die zukünftige Kennzeichnungspflicht von KI-generierten Inhalten regeln sollen und sich derzeit im Prüfverfahren befinden [12]. Parallel dazu entwickeln und implementieren auch Hochschulen eigene Vorstellungen und verbindliche Regelungen hinsichtlich der Ausgestaltung dieser Kennzeichnungspflicht [13–15].

Interessanterweise wurden in der Umfrage ethische Bedenken nur verhalten geäußert und die Angst vor einem Arbeitsplatzverlust durch KI war praktisch nicht vorhanden. Eine naheliegende Interpretation dieses Befundes ist, dass die Befragten KI primär als ergänzendes Werkzeug und weniger als Ersatz für menschliche Arbeit wahrnehmen – eine Sichtweise, die auch in aktuellen Diskussionen über die Chancen der Zusammenarbeit von Mensch und KI hervorgehoben wird [15]. Allerdings muss dieses Ergebnis kritisch eingeordnet werden, insbesondere im Hinblick auf die spezifische Zusammensetzung der Stichprobe. Da der Großteil der Teilnehmenden im Gesundheitssektor beschäftigt ist – einer Branche, in der die menschliche Komponente als zentral gilt – ist die geringe Sorge vor Verdrängung möglicherweise branchenspezifisch. Dass in anderen Sektoren bereits ein Wandel stattfindet, deuten externe Analysen an: Eine Erhebung von Revelio Labs zeigt, dass die Anzahl von Stellenausschreibungen für Tätigkeiten, die durch KI automatisiert werden können, seit 2022 bereits kontinuierlich rückläufig ist. Das Ergebnis der vorliegenden Studie spiegelt also womöglich eher die optimistische Haltung einer spezifischen Berufsgruppe wider, während in der Gesamtbevölkerung oder in anderen Branchen eine differenziertere oder besorgtere Haltung vorherrschen könnte [16].

Herausforderungen für Bildungseinrichtungen und Lese- und Schreibkompetenz

Die sehr kritische Einschätzung des Vorbereitungsstands der Bildungseinrichtungen ist alarmierend. Sie weist auf eine erhebliche Lücke zwischen der rasanten Entwicklung von KI-Technologien und der Anpassung der Lehr- und Lernumgebungen hin. Gleichzeitig besteht die Sorge, dass sich das allgemeine Lese- und Schreibverständnis durch die dauerhafte Nutzung von Chatbots verschlechtern könnte. Diese Sorge wird durch experimentelle Befunde untermauert, wie eine Studie von Kosmyna et al. zeigt, in der die neurologischen Auswirkungen des Schreibens mit LLM-Unterstützung untersucht wurden. In dieser Studie wurde die Gehirnaktivität von drei Gruppen verglichen: eine, die mit einem LLM arbeitete, eine, die eine Suchmaschine nutzte, und eine Kontrollgruppe ohne Hilfsmittel. Die Ergebnisse zeigten, dass die LLM-Gruppe die schwächste neuronale Konnektivität aufwies, während die Gruppe ohne Hilfsmittel die stärkste zeigte [4]. Dieser Befund liefert eine neurologische Grundlage für die Befürchtung, dass eine übermäßige Abhängigkeit von KI zu einer kognitiven Passivität führen könnte. Dieses Ergebnis ist ein wichtiger Punkt, der im Hinblick auf die langfristigen Auswirkungen von KI auf kognitive Fähigkeiten und Bildungsziele Beachtung finden sollte [6][17].

Schlussfolgerung

Die vorliegenden Ergebnisse belegen die weitreichende Verankerung von KI, insbesondere von LLMs, im wissenschaftlichen Alltag, wo sie primär als Effizienzsteigerungswerkzeug bei textbezogenen Aufgaben wahrgenommen werden. Trotz dieses erkennbaren Nutzens ist die Nutzung dieser generativen Technologien mit erheblichen Risiken für die wissenschaftliche Integrität verbunden, deren Management dringend erforderlich ist. Die zentrale Herausforderung liegt in der mangelnden Verlässlichkeit der generierten Inhalte. Das kritischste Problem ist die Neigung zu sogenannten Halluzinationen, bei denen Modelle faktisch inkorrekte Informationen mit hoher sprachlicher Plausibilität ausgeben. Diese Problematik wird im wissenschaftlichen Kontext durch das Risiko des ungenauen oder erfundenen Zitierens verschärft, da die Modelle keine korrekten und verifizierbaren Quellen gewährleisten können. Hinzu kommt der Black-Box-Charakter der Modelle, der die mangelnde Nachvollziehbarkeit logischer Schlussfolgerungen und Auswertungen bedingt und somit grundlegenden Forderungen nach Transparenz und Reproduzierbarkeit widerspricht. Ebenso bedenklich ist die Verstärkung von Bias und Stereotypen aus den Trainingsdaten, die systematische Verzerrungen in generierten Texten und Datenauswertungen verursachen kann. Im Bereich der Bildgenerierung führen Urheberrechtsverletzungen und die leichte Erzeugung von Deepfakes zu weiteren ethischen und desinformativen Risiken. Schließlich stellen auch technische Sicherheitslücken eine Gefahr für die Datensicherheit dar. Die Umfrageergebnisse unterstreichen somit die dringende Notwendigkeit für klare, einheitliche und fächerübergreifende Richtlinien zur KI-Nutzung. Angesichts der dokumentierten Zuverlässigkeitsprobleme ist die kritische menschliche Überprüfung aller KI-generierten Ergebnisse unerlässlich. Bildungseinrichtungen müssen ihre Vorbereitung verbessern, um Forschende und Studierende im verantwortungsvollen Management der Chancen und Risiken zu schulen und damit die langfristige Sicherung der wissenschaftlichen Integrität zu gewährleisten.

Ausblick

Um den verantwortungsvollen Einsatz von KI im wissenschaftlichen Kontext zu gewährleisten, sind weitere Schritte notwendig. Dazu gehört die Entwicklung und Implementierung umfassender Leitlinien für den Umgang mit KI-Tools durch Hochschulen, Forschungseinrichtungen und Fachgesellschaften. Diese Richtlinien sollten nicht nur die Kennzeichnungspflicht von KI-generierten Inhalten regeln, sondern auch klare Empfehlungen für den ethischen Einsatz und die Sicherstellung der Datenhoheit und des Datenschutzes formulieren. Für Bildungseinrichtungen ergibt sich die Herausforderung, Curricula anzupassen und Lehrende sowie Studierende im kompetenten und kritischen Umgang mit KI zu schulen. Dies beinhaltet nicht nur die technische Anwendung, sondern auch die Schulung im Quellenmanagement, in der Plagiatsprävention und in der Förderung des kritischen Denkens, um einer möglichen Verschlechterung des Lese- und Schreibverständnisses entgegenzuwirken. Zukünftige Forschung sollte die spezifischen Auswirkungen von KI auf verschiedene wissenschaftliche Disziplinen detaillierter untersuchen und Best Practices für den Einsatz von KI-Tools in der Forschung und Lehre entwickeln. Nur so lässt sich das volle Potenzial von KI ausschöpfen, ohne die Grundprinzipien wissenschaftlicher Exzellenz und Integrität zu gefährden.

Limitation

Die vorliegende Umfrage reflektiert weitgehend die aktuelle Einstellung zur Nutzung von KI im wissenschaftlichen Kontext. Für eine umfassendere und diversifiziertere Perspektive wäre eine höhere Beteiligung von Teilnehmenden aus anderen Fachbereichen wünschenswert gewesen. Dies hätte einen breiteren Querschnitt der wissenschaftlichen Gemeinschaft abgebildet und die Generalisierbarkeit der Ergebnisse potenziell erhöht.

Danksagung

Unser aufrichtiger Dank gebührt allen Personen, die an der Umfrage teilgenommen und somit die Generierung dieser Ergebnisse ermöglicht haben.

Transparenzhinweis

Für die Erstellung dieser Umfrage wurden ChatGPT (OpenAI, San Francisco, USA) und Google Gemini (Google, Mountain View, USA) zur sprachlichen Optimierung und zur Auswertung der offenen Fragen verwendet.

Interessenkonflikt

Die Autoren haben keine finanziellen Interessen oder Beziehungen, die zu Interessenkonflikten führen können.

Kurzer wissenschaftlicher Lebenslauf

Jan Turra ist seit 2019 stellvertretender Leiter der Perfusiologie am Universitätsklinikum Heidelberg. Er studierte Cardiovascular Perfusion (B.Sc.) an der Akademie für Kardiotechnik und absolvierte anschließend den Masterstudiengang Technical Physician (M.Sc.) an der Hochschule Furtwangen. Seit 10/2024 befindet sich Jan Turra berufsbegleitend im Promotionsverfahren für den Dr. sc. hum. Seit 08/18 ist Jan Turra verantwortlich für die Betreuung von Studierenden verschiedener Fachhochschulen, Master- und Bachelorarbeiten in seinem Fachgebiet. Sein aktueller Forschungsschwerpunkt liegt im Bereich der Grundlagenforschung in der Perfusiologie.

Literatur

- Luterbach KJ. Considering the History of Technologies in Education, the Distinctiveness of AI Apps, and the Future of Educational Systems. Xi Lin, Roy Y. Chan, Shyam S, Krishna Bista, editors.STAR SCHOLARS PRESS. STAR SCHOLARS PRESS; 2024. 19–46 p.

- Christen M, Mader C, Čas J, Abou-Chadi T, Bernstein A, Braun Binder N, et al.Wenn Algorithmen für uns entscheiden: Chancen und Risiken der künstlichen Intelligenz – Google Books. 1st ed. Vol. Band 72, VDF Hochschulverlag. TA-Swiss; 2020

- Revell T, Yeadon W, Cahilly-Bretzin G, Clarke I, Manning G, Jones J, et al. ChatGPT versus human essayists: an exploration of the impact of artificial intelligence for authorship and academic integrity in the humanities. International Journal for Educational Integrity. 2024 Dec;20(1):1–19.

- Kosmyna N, Hauptmann E, Yuan YT, Situ J, Liao XH, Beresnitzky AV, et al. Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task. 2025 Jun 10

- Google Gemini [KI Modell] [Internet]. Google DeepMind; 2025.

- Khalifa M, Albadawy M. Using artificial intelligence in academic writing and research: An essential productivity tool. Computer Methods and Programs in Biomedicine Update. 2024 Jan 1; 5:100145.

- Findenig A. Künstliche Intelligenz im HR-Bereich und deren Anwendungsbereiche. [Graz]: Campus Graz 02; 2024.

- Wirtz BW, Meyerer JC. Wissenschaftliche Beiträge Künstliche Intelligenz: Erscheinungsformen, Nutzungspotenziale und Anwendungsbereiche. 2019 Nov; 10:4–10.

- Fenwick C, Qureshi Z. Risks from power-seeking AI systems. 2025. 80000hours

- Sonntagbauer M, Haar M, Kluge S. Artificial intelligence: How will ChatGPT and other AI applications change our everyday medical practice? Med Klin Intensivmed Notfmed. 2023 Jun 1; 118(5):366–71.

- Universität Augsburg. KI in der Literaturrecherche 2024.

- EU AI Act: first regulation on artificial intelligence | Topics | European Parliament.

- Universität Basel. Leitfaden «Aus KI zitieren» Umgang mit auf Künstlicher Intelligenz basierenden Tools. 2025 Aug; 3.0:1–5.

- KI-Kennzeichnung – Universitäts- und Landesbibliothek – TU Darmstadt.

- Universität Leipzig. Kennzeichnung von KI-generierten Inhalten | Knowledge Base | E-Learning 2024.

- Zweig B. The Tasks You Won’t See in Job Postings Anymore | Revelio Labs. 2025.

- Wang J, Fan W. The effect of ChatGPT on students’ learning performance, learning perception, and higher-order thinking: insights from a meta-analysis. Humanities and Social Sciences Communications 2025 12:1. 2025 May 6; 12(1):1–21.